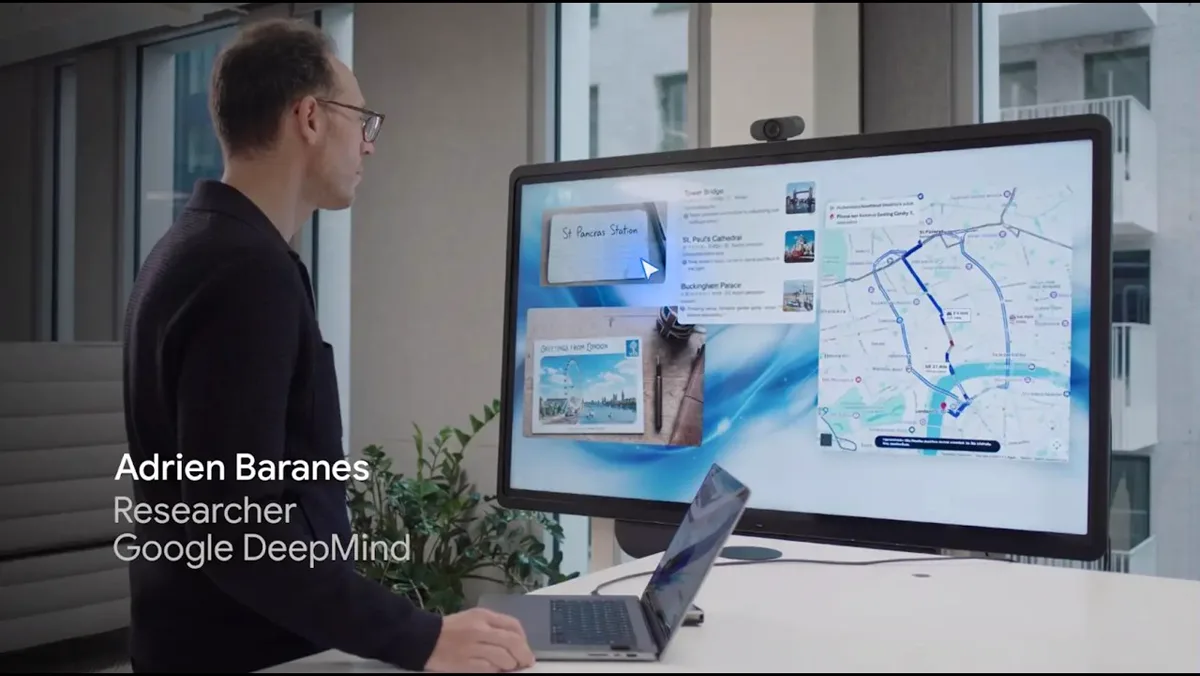

O Google DeepMind apresentou uma proposta para “reimaginar” uma interface de 50 anos — o ponteiro do mouse — usando IA para transformar o cursor em um agente que entende intenção e ajuda a executar tarefas diretamente na tela, reduzindo cliques, menus e microajustes repetitivos. A ideia central é substituir o ponteiro puramente geométrico (x/y) por um ponteiro “semântico”: ele não aponta só para pixels, mas para significado do que está na interface.

O que muda: de coordenadas para intenção

No modelo tradicional, o mouse é um dispositivo de precisão: você move um cursor até um alvo e clica. O DeepMind argumenta que esse paradigma envelheceu porque a tela moderna é carregada de elementos, estados e fluxos, e o custo cognitivo de “dirigir” o cursor vira gargalo. A proposta com IA é o cursor virar uma camada de compreensão do contexto, antecipando o que o usuário quer fazer e oferecendo ações relevantes.

Na prática, isso significa que o ponteiro deixa de ser apenas um indicador visual e passa a funcionar como um “assistente local” para a interface. Em linguagem simples: ao invés de você caçar opções e atalhos, o cursor passa a sugerir e executar passos com base no que está na tela e no que você está tentando alcançar.

Como isso funciona (em termos simples) e por que importa

O vídeo descreve a abordagem como uma nova forma de interação apoiada por modelos de IA capazes de interpretar conteúdo visual e estruturas de UI (botões, listas, campos, janelas) para decidir qual ação faz sentido naquele momento. Isso é diferente de automação rígida (macros): a IA tenta generalizar para interfaces variadas.

Para quem trabalha com desenvolvimento de jogos, ferramentas 3D e editores complexos (como DCCs e engines), o impacto potencial é direto: workflows têm muitos passos pequenos — abrir painéis, ajustar parâmetros, navegar hierarquias — e um ponteiro que “entende” o que você está fazendo poderia reduzir atrito em tarefas repetitivas e acelerar iterações.

Do “assistente” ao “agente” na UI

O DeepMind enquadra o projeto como um passo rumo a agentes capazes de operar softwares de forma mais natural. Agente, aqui, é um sistema que não só responde a comandos, mas planeja e executa ações na interface para alcançar um objetivo (por exemplo, configurar algo, encontrar uma opção, ou completar um fluxo).

Em termos didáticos: ao invés de você memorizar onde ficam recursos em menus e submenus, a IA passa a localizar e acionar componentes da interface. Isso muda a acessibilidade e a produtividade, especialmente em programas que têm muitas telas, modos e atalhos.

O que observar daqui para frente

A proposta abre discussões técnicas e de produto: como garantir previsibilidade (o cursor não “inventar” ações), como dar controle e reversibilidade ao usuário, e como integrar isso a sistemas existentes sem quebrar padrões de UI. O vídeo posiciona a ideia como um redesenho de interface, não apenas um recurso isolado.

Para ver as demonstrações e a explicação completa do conceito em ação, assista ao vídeo oficial do DeepMind.

Fonte: Google DeepMind