A Reallusion apresentou um fluxo de trabalho que muda o jogo para animação 2D: usar o Cartoon Animator como “base controlada” (poses, rig e acting) e acoplar IA para gerar variações, editar partes específicas da imagem e até criar clipes de 5 a 6 segundos via image-to-video — tudo sem abrir mão do controle de cena que a produção profissional exige.

O ponto central do vídeo é pragmático: hoje ainda não existe uma plataforma única que entregue o produto final inteiro. Em vez disso, o ganho está em combinar ferramentas: ChatGPT para conceito e roteiro, editores e geradores de vídeo por IA para acelerar trechos, e um editor de pós (como CapCut) para montar a narrativa com consistência.

Na demonstração, a criação começa com um prompt simples no ChatGPT (um cartoon de zebra dirigindo um conversível na praia) e evolui com iterações rápidas. O valor aqui não é só “gerar uma imagem”, mas reduzir o tempo entre ideia e material visual utilizável em produção.

O gargalo da IA: consistência e custo de tentativa e erro

O vídeo não romantiza: consistência “quase lá” ainda não é consistência de pipeline. Em muitos serviços, pequenas mudanças pedidas no prompt podem alterar elementos não relacionados da cena, quebrando continuidade entre planos. Além disso, por trás de cada frame bom existe tentativa e erro — o que pesa especialmente quando o uso depende de assinaturas pagas.

É aqui que entra o destaque técnico do vídeo: o Nano Banana (integrado ao editor de imagens do “Invado/Envato”, como citado na transcrição) promete alterar apenas as partes solicitadas — roupa, óculos, cor do carro, objetos de cena — em vez de “embaralhar” a composição inteira. Na prática, isso ajuda a manter continuidade visual entre takes e reduz retrabalho.

Image-to-video: clipes curtos guiados por imagens de início e fim

Outro ponto de alta densidade: o editor de image-to-video citado gera um plano de aproximadamente 5 a 6 segundos a partir de duas imagens (primeiro e último quadro) + uma descrição do que acontece entre elas. Para animação, isso funciona como um “preenchimento automático” de movimento, útil para transições, ações simples e cenas de establishing.

O pulo do gato para quem trabalha com jogos, Unreal e cinemáticas é entender o papel do Cartoon Animator: ele garante pose e expressão porque o personagem 2D já está rigado (ou seja, com esqueleto/controles prontos para animar). A IA entra depois para reimaginar em 3D, criar variações, e gerar movimento de câmera/ação — acelerando prévias e animatics sem perder direção.

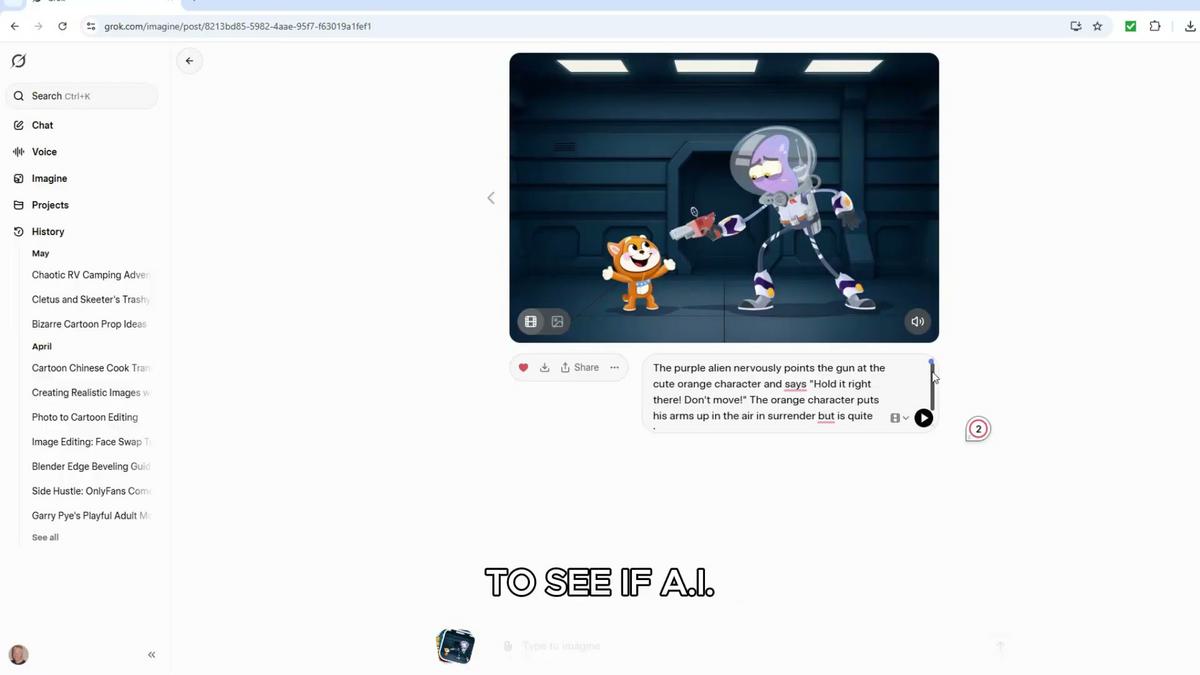

Voz por IA e testes de dublagem com Grok 3

Além de imagem e vídeo, a Reallusion mostra um experimento de voz: adicionar dublagem por IA com Grok 3. A ideia é simples de aplicar: usar personagens 2D já existentes e testar falas com prompts diferentes para validar timing, humor e intenção antes de gravar voz final (ou até para ficar como versão final em protótipos rápidos).

Aplicações diretas: sprites, props, fundos animados e referência de personagem

O vídeo também lista usos práticos que conversam com pipeline de game dev 2D: gerar sequências de sprite (exportando frames e montando um prop multi-sprite), criar fundos animados a partir de uma imagem estática e produzir ângulos de referência do personagem. Em termos simples: a IA vira uma “fábrica” de variação visual e motion curto, enquanto o artista mantém a direção criativa.

A síntese editorial é objetiva: IA acelera, mas ainda precisa de um “chefe criativo” para manter continuidade, intenção e narrativa. Para ver os testes de consistência, as trocas de ângulo com Nano Banana e os clipes gerados no image-to-video rodando na prática, vale assistir ao material oficial.

Fonte: Reallusion