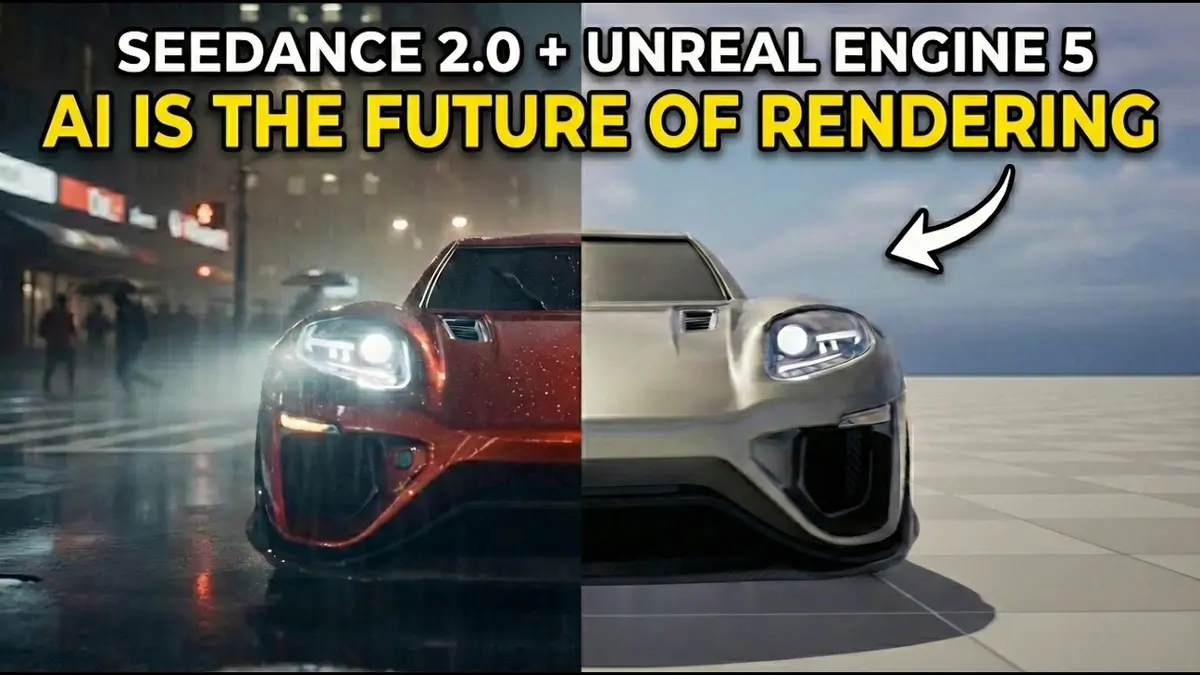

Um teste prático publicado pelo criador Jay, do canal JSFILMZ, mostrou um fluxo de trabalho que pode mudar a pré-produção em 3D: usar o Unreal Engine 5 para bloquear (pré-visualizar) uma cena com animações de câmera e, em seguida, pedir ao Cascade 2.0 para replicar esses movimentos na geração final. O resultado funciona, mas não é 1:1 — o modelo ainda erra direção de câmera e sofre com inconsistência quadro a quadro.

Como o teste foi feito: carro “stock” do UE5 e câmera como referência

No vídeo, Jay explica que a base foi simples: ele pegou o vehicle padrão do Unreal Engine 5 (o veículo “stock”, que vem pronto) e criou “um par de” animações de câmera. Depois, ele renderizou esse clipe no UE5 e usou o vídeo como referência para o Cascade 2.0 mimetizar (tentar copiar) os movimentos de câmera.

O detalhe importante: ele não importou modelos do Unreal para a ferramenta de IA. Segundo Jay, os carros exibidos são do próprio Cascade 2.0. Ou seja, o Unreal Engine 5 entra aqui como ferramenta de layout e câmera, não como fonte direta de assets.

O que funciona — e onde quebra

Na prática, algumas tomadas “seguem” muito bem a câmera do clipe original. Ele cita uma animação simples, em visão mais de cima (top-down), que foi replicada “bem legal”, com bom acompanhamento do movimento.

Mas o vídeo também expõe o principal limite: nem sempre o Cascade 2.0 copia a câmera de forma fiel. Jay diz que o resultado “não é 100%” e que, em algumas gerações, a ferramenta chega a reverter o movimento.

Quando a IA “alucina” a câmera

O caso mais claro do teste: o clipe original tinha um deslocamento de câmera da esquerda para a direita, mas a geração do Cascade 2.0 fez o caminho contrário. Para comparar corretamente, Jay afirma que precisou flipar o clipe original do UE5 (inverter horizontalmente) para bater com a direção que a IA entregou.

Em termos simples: mesmo com uma referência objetiva (um vídeo renderizado), o sistema ainda “interpreta” o movimento em vez de reproduzir com exatidão. Para quem depende de previsibilidade — publicidade, automotivo, cinematics, trailers — isso vira retrabalho.

Consistência entre frames: o ponto crítico para realismo

Além da trajetória da câmera, Jay chama atenção para um problema que costuma denunciar render por IA: consistência (manter o mesmo objeto igual ao longo do tempo). Ele descreve mudanças sutis durante um movimento lateral: o capô do carro “suaviza” demais e partes parecem se misturar até virar uma superfície mais plana.

Traduzindo: mesmo que a tomada pareça boa num frame isolado, a continuidade pode quebrar quando você assiste em tempo real, porque detalhes “derretem” ou mudam de forma. Para realismo, isso é um gargalo tão grande quanto errar o movimento da câmera.

A conclusão do teste: já dá para bloquear no UE5 e renderizar com IA — com ressalvas

O veredito do vídeo é direto: sim, dá para usar o Unreal Engine 5 como ferramenta de blocking (planejar a cena, posicionar câmera e ritmo) e depois renderizar com o Cascade 2.0. Mas, hoje, o processo ainda não é confiável o suficiente para exigir cópia “um para um”: a ferramenta pode alucinar a câmera e oscilar na estabilidade visual.

O que isso sinaliza para o futuro dos engines

Jay encerra com uma leitura de tendência: ele acredita que, no futuro, game engines vão usar IA para renderizar cenas. Ele não crava como isso vai se comportar em hardware ou custo — se será mais caro que path tracing em tempo real (técnica de iluminação fisicamente correta e pesada) — mas aposta numa fusão inevitável entre IA e gráficos de jogos.

Para ver os exemplos, comparações e os erros de câmera acontecendo na prática, assista ao vídeo oficial.

Fonte: JSFILMZ