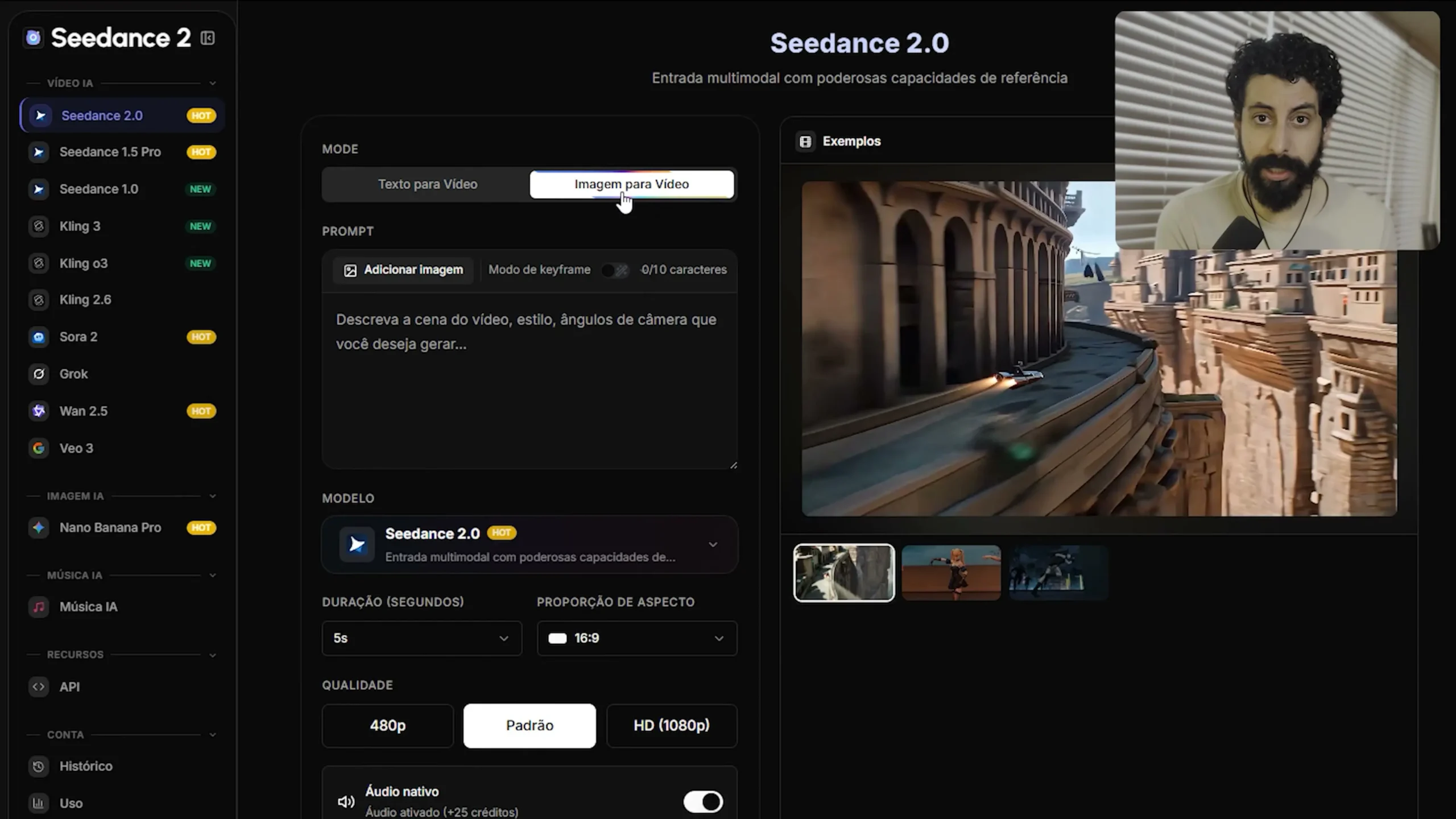

O lançamento do Sidans 2.0, uma IA de geração de vídeo atribuída à ByteDance (grupo por trás do TikTok), colocou na rua um salto técnico que está mudando a conversa na indústria 3D: além de criar cenas “cinematográficas” via prompt, a ferramenta promete manter consistência de personagens ao longo do tempo usando referências (imagens e até vídeo), atacando um dos gargalos clássicos dos modelos atuais — a continuidade entre frames.

O estopim do debate foi um clipe que viralizou simulando uma briga entre Brad Pitt e Tom Cruise. O ponto, aqui, não é só o “efeito uau”: o vídeo é citado como um exemplo de como resultados com estética de Hollywood podem surgir rapidamente quando um modelo é lançado com capacidade de produzir cenas realistas e replicáveis em massa.

O que muda na prática: prompt + referências para “memória” de cena

No fluxo descrito no vídeo, o Sidans 2.0 aceita texto, imagens e entrada de vídeo. A lógica é simples: você descreve a cena (prompt) e ancora o resultado em referências visuais — inclusive com “mais de 10 imagens” — para que a IA entenda quem é quem e preserve identidade, figurino e aparência ao longo do trecho.

Em termos didáticos: “consistência temporal” é a capacidade de manter o mesmo personagem coerente do início ao fim, sem “trocar de rosto” ou mudar detalhes a cada frame. Isso é exatamente onde muitas IAs de vídeo ainda falham — e é por isso que a promessa do Sidans 2.0 pesa tanto para cinema, publicidade e animação.

Por que isso ameaça o pipeline 3D (e o que entra no lugar)

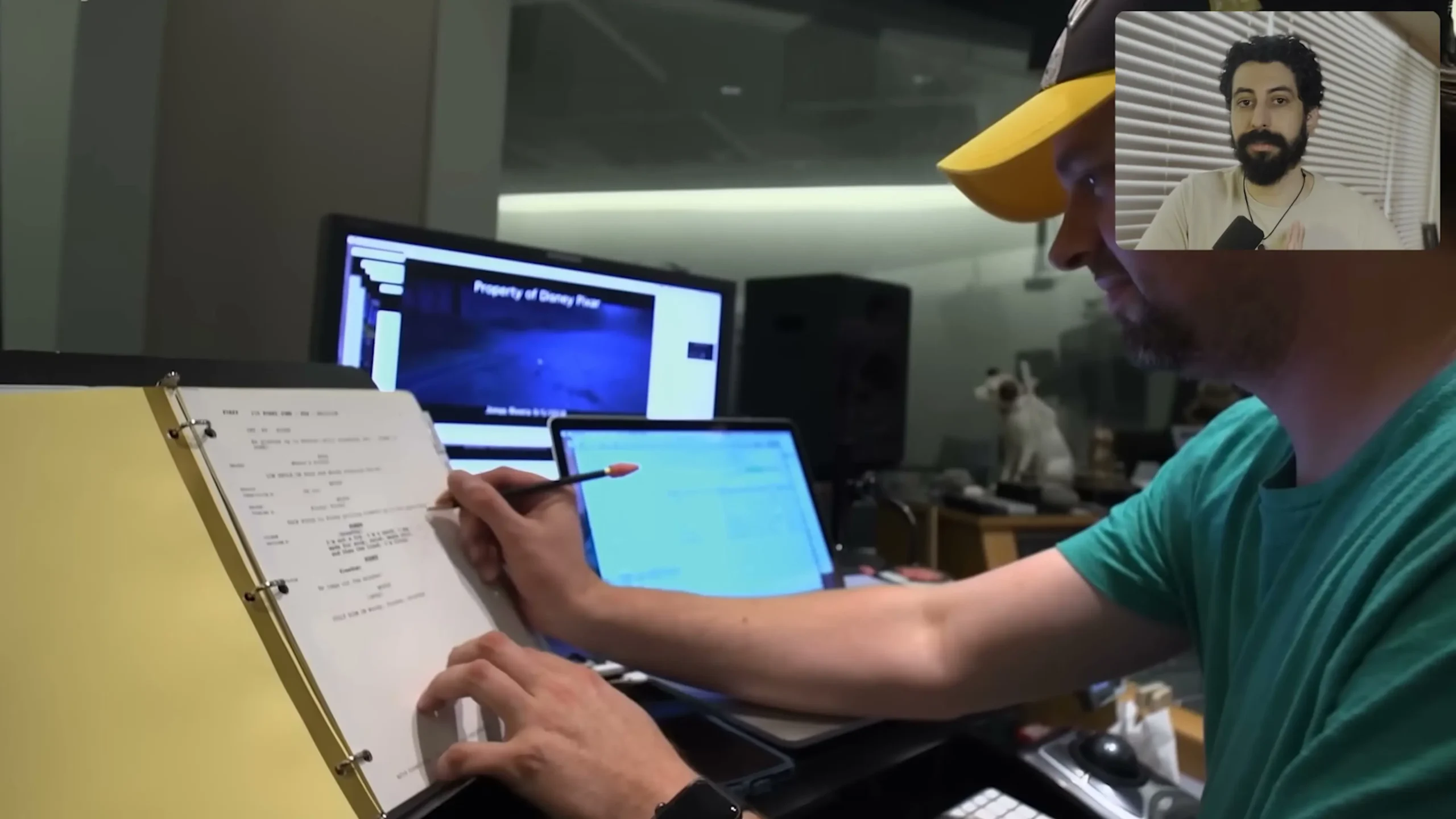

O vídeo contrapõe esse novo fluxo com o pipeline tradicional de animação 3D no estilo Pixar/Disney: conceito, desenho, definição de cor, modelagem, criação de malha (vértices), rigging e “ossos” (o esqueleto do personagem), e só então animação e refinamento. É um processo caro, longo e altamente especializado.

Quando uma IA permite chegar em “resultado pronto” a partir de prompt e referência, o impacto prático é direto: menos etapas manuais e menos tempo entre ideia e cena. Isso não elimina a necessidade de direção, narrativa e curadoria — mas comprime a parte mais repetitiva e técnica do trabalho, mudando o peso do que é “produção”.

Controle fino: a tendência de fluxos por nós (tipo ComfyUI)

Um detalhe importante: o vídeo aponta que a indústria deve buscar mais controle sobre essas gerações, e cita interfaces em grafo como o ComfyUI — ferramentas onde você “liga nós” para montar um pipeline visual de geração e edição. Em linguagem simples, é como transformar prompt solto em processo, com etapas repetíveis e ajustáveis.

O exemplo dado é emblemático: alterar uma referência (como “deixar o personagem careca”) e obter a mudança preservando o resto. Esse tipo de edição guiada por imagem é o caminho mais provável para estúdios: menos “aperta e reza”, mais previsibilidade.

Copyright, adoção em massa e o choque com Hollywood

O lançamento também veio acompanhado de controvérsia. O vídeo afirma que circularam demonstrações com propriedade intelectual e material protegido, e que empresas como Disney e outros grandes players teriam reagido pedindo barreiras. Na prática, esse é o atrito inevitável quando um gerador de vídeo “realista” encontra celebridades, personagens e estilos reconhecíveis.

Mas o argumento central é econômico: se a produção ficar muito mais barata e o público prestar atenção, a adoção acontece — independente de resistência cultural inicial. O efeito colateral para quem trabalha com 3D é claro: tarefas mais “pesadas” tendem a ser automatizadas, e o diferencial migra para direção, design, identidade e história.

E o Unreal Engine no meio disso?

Do ponto de vista de animação e conteúdo cinematográfico, o vídeo é direto ao prever que o Unreal Engine pode perder espaço em parte do mercado de animação 3D, justamente porque a geração por IA reduziria a necessidade de construir cenas por pipeline tradicional em tempo real. Em jogos, porém, a avaliação é diferente: criar sistemas interativos com regras, progressão e consistência ainda exige outra camada de engenharia e design.

O recado final é pragmático: o público vai escolher pelo resultado — o que “faz sentir algo” — e não pelo método. Para devs e artistas, o movimento mais seguro é entender o que está sendo automatizado e onde o valor humano vai se concentrar.

Para ver os exemplos e a análise completa em ação, assista ao vídeo original no YouTube.

Fonte: Neriverso