Em um comparativo direto entre os dois modelos “top do momento” para geração de vídeo por IA, o Seedance 2.0 levou vantagem sobre o Kling 3.0 em consistência de cena, transições físicas (fogo) e microdetalhes (spray de água) — e, principalmente, em áudio e lip sync, onde o Kling 3.0 ainda “alucina” falas e não encaixa bem a boca no diálogo.

O teste foi publicado pelo criador Jay, do canal JSFILMZ, usando prompts iguais e, em alguns casos, a mesma imagem-base para ambos os sistemas. A proposta é pragmática: medir como cada modelo se comporta em situações que derrubam projetos de cinemática, pré-visualização e trailers de jogos quando algo sai do “fisicamente crível”.

Teste 1: “prop transferring” expõe o gargalo do Kling 3.0 em áudio

O primeiro benchmark foi prop transferring (transferência de objeto), uma cena comum em narrativa: uma pessoa entrega um item para outra. Esse tipo de ação cobra coerência de mãos, contato, trajetória do objeto e enquadramento — detalhes que, se falham, entregam na hora que é IA.

Segundo o autor, os dois modelos “foram bem” na movimentação, mas o Kling 3.0 mostrou problemas recorrentes: áudio inconsistente e lip sync atrasado/errado. Na prática, isso significa que você pode ter uma animação aceitável, mas perde a tomada inteira quando a fala não bate com a boca — um erro crítico para cutscenes e comerciais.

Outro ponto citado foi o framing estranho do Kling 3.0 (enquadramentos que mudam ou “pensam por conta própria”), algo que complica pipelines de direção de cena, especialmente quando a equipe quer iterar rapidamente em shots previsíveis.

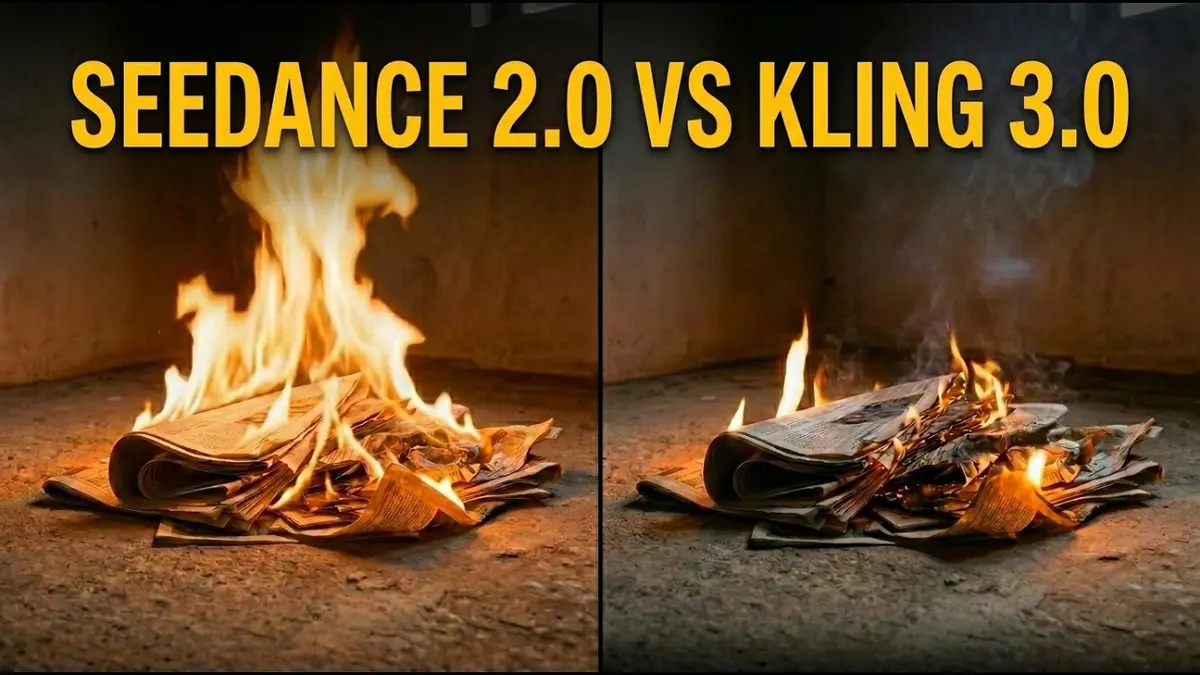

Teste 2: fogo (imagem-para-vídeo) e a importância da transição física

No segundo teste, o foco foi fogo. Aqui entra uma aplicação muito usada em VFX e prototipação: image-to-video (imagem-para-vídeo), quando você fornece um frame estático como base e pede para o modelo animar com um prompt. O autor diz ter usado a mesma imagem para ambos (gerada no Nano Banana) e um comando do tipo “um fósforo cai e inicia a chama”.

No Kling 3.0, o fogo até “parece bom” depois que aparece, mas a crítica é a proceduralidade (como o evento nasce e se propaga). Em vez de uma ignição gradual e conectada ao ponto de contato, a chama surge em regiões sem continuidade clara — e ainda aparece uma mão entrando na cena de forma esquisita, um tipo de artefato comum quando o modelo tenta “inventar” a causa da ação.

No Seedance 2.0, embora também haja atalhos visuais (a queima lembra um “burst” como se tivesse fluido inflamável), o modelo apresentou uma transição mais legível: o fogo começa, a fumaça anima e a propagação parece mais conectada entre áreas. Em termos práticos, isso reduz retrabalho quando você precisa de uma tomada que passe por revisão de direção de arte sem “mágica” demais no meio do shot.

Teste 3: ondas e spray — microdetalhes que vendem realismo

O terceiro benchmark foi água, novamente com uma imagem base. O objetivo: observar ondas, quebra de crista e o spray. Para quem produz cinemáticas ou cenas costeiras em jogos, esses elementos são um teste duro porque o olho humano reconhece padrões “falsos” rapidamente.

O Kling 3.0 foi descrito como “não ruim”, mas com um aspecto mais artificial e quebras aleatórias. Já o Seedance 2.0 teria entregado água mais refinada, com um detalhe específico citado como decisivo: a névoa/mist logo após o impacto da onda, um comportamento sutil que aproxima o resultado do mundo real.

Esse tipo de microassinatura física é o que costuma separar um clipe “ok para redes sociais” de um material que pode entrar como placa de referência para simulação em Houdini, Blender ou uma cena de Unreal Engine — mesmo que seja só para prévia (previs) e não para final.

Veredito do comparativo e o “top 2” do momento

Na conclusão do vídeo, o autor posiciona Seedance 2.0 e Kling 3.0 como os dois melhores sistemas no momento, com VO3 em terceiro (na opinião dele). E o resultado geral do teste pende para o Seedance 2.0 por consistência audiovisual e transições mais críveis.

Para quem trabalha com desenvolvimento de jogos, 3D e Unreal, a leitura é direta: modelos que erram lip sync, enquadramento e causalidade física podem até acelerar brainstorm, mas ainda travam quando o objetivo é gerar takes reutilizáveis em um pipeline de narrativa.

Assista ao comparativo completo para ver os clipes lado a lado, com as observações do autor em tempo real.

Fonte: JSFILMZ