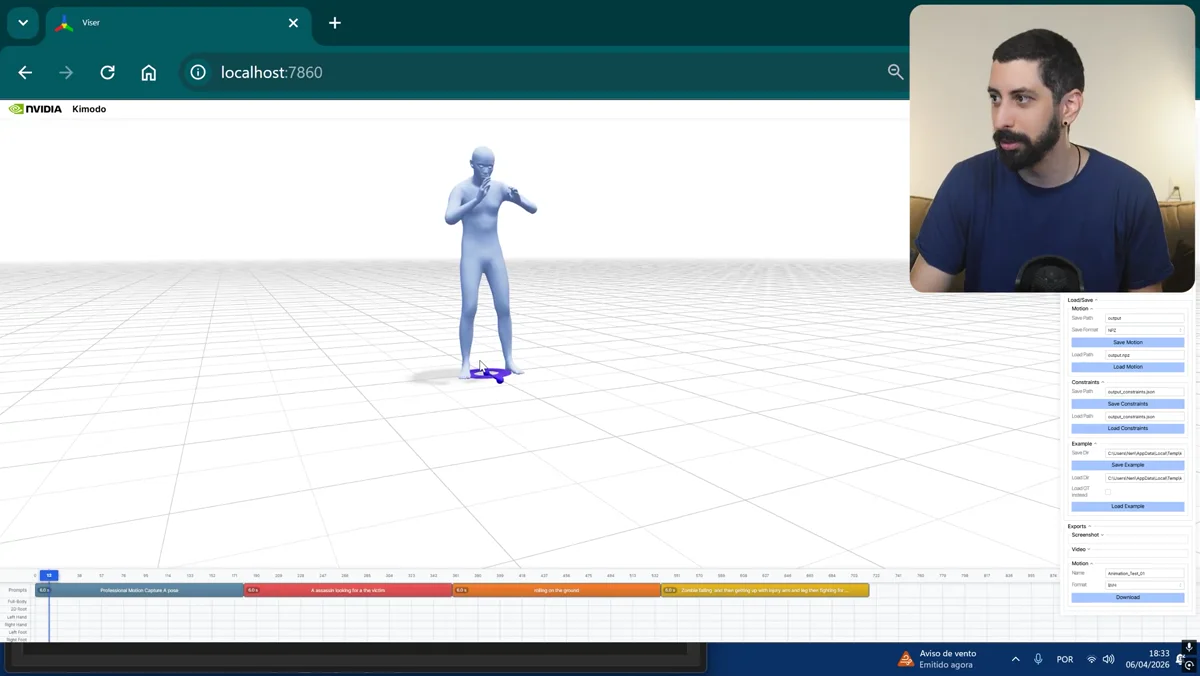

A Nvidia liberou uma nova IA capaz de gerar animações 3D a partir de texto, com opção de exportação para uso em pipelines reais de produção. A proposta é simples e poderosa: descrever a ação em linguagem natural e receber como saída um movimento pronto para ser reaproveitado em personagens, cenas e protótipos de jogos.

Mesmo em estágio inicial, o salto é evidente para quem acompanha animação e game dev: sair do texto para um clipe animado encurta etapas que antes exigiam captura de movimento, keyframes ou trabalho especializado. O resultado ainda pede ajustes e validação, mas a direção é clara: acelerar a criação de conteúdo 3D.

Rodando localmente: promissor, mas ainda trabalhoso

A ferramenta pode ser executada localmente, o que abre espaço para levar a geração de animação para qualquer lugar e incorporar rapidamente em projetos. Em contrapartida, a instalação e configuração ainda são “chatas” — algo esperado no começo de uma tecnologia desse tipo.

O ponto importante é entender o momento: a fricção atual tende a diminuir conforme a ferramenta amadurece, ganha documentação e passa a receber integrações mais diretas com softwares e engines do mercado.

Exportação em BVH e o gargalo do retargeting

A animação gerada sai em BVH, um formato bastante conhecido para dados de movimento, mas que não resolve sozinho o problema da compatibilidade entre rigs. O BVH é lido no Blender, porém o esqueleto raramente “casa” perfeitamente com o personagem final.

Por isso, entra o retargeting: o mapeamento dos ossos do BVH para outro esqueleto. Depois desse remapeamento, a animação passa a funcionar em personagens diferentes e pode seguir para outras etapas do pipeline, como ferramentas de animação, edição e preparação para engine.

Com o retargeting concluído, fica viável levar o movimento para softwares como iClone 8, ganhar controle mais refinado e então exportar para onde fizer sentido — incluindo fluxos voltados a Unreal Engine, com potencial para combinações com rigs comuns (como MetaHuman).

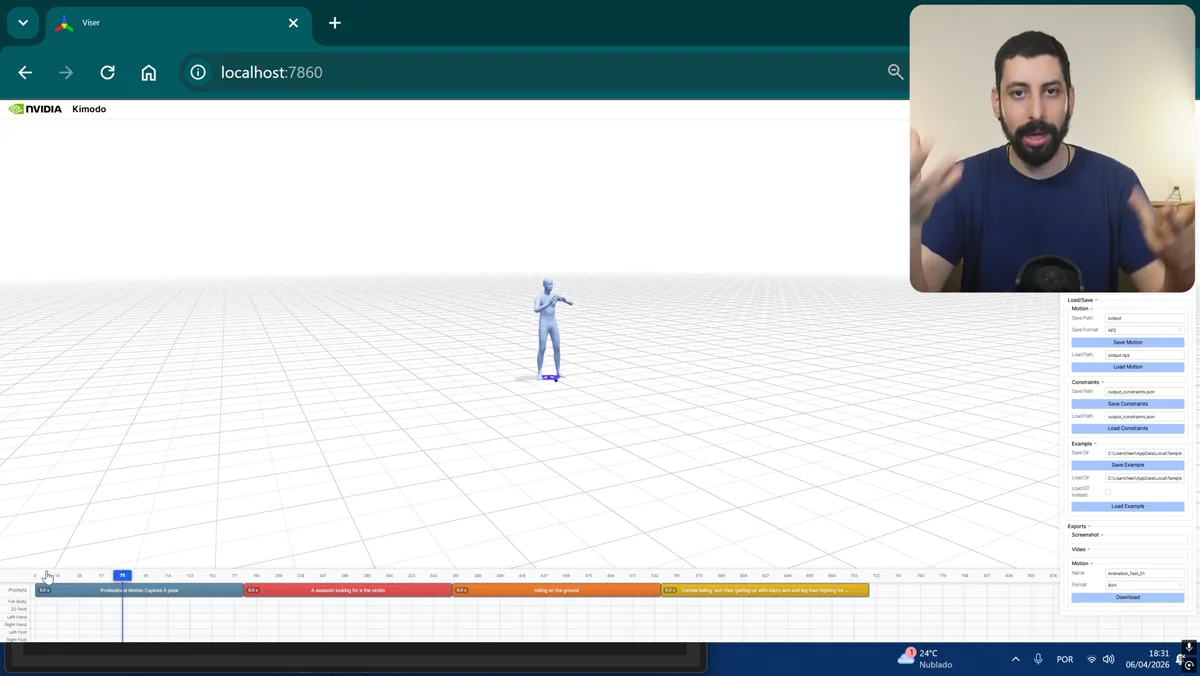

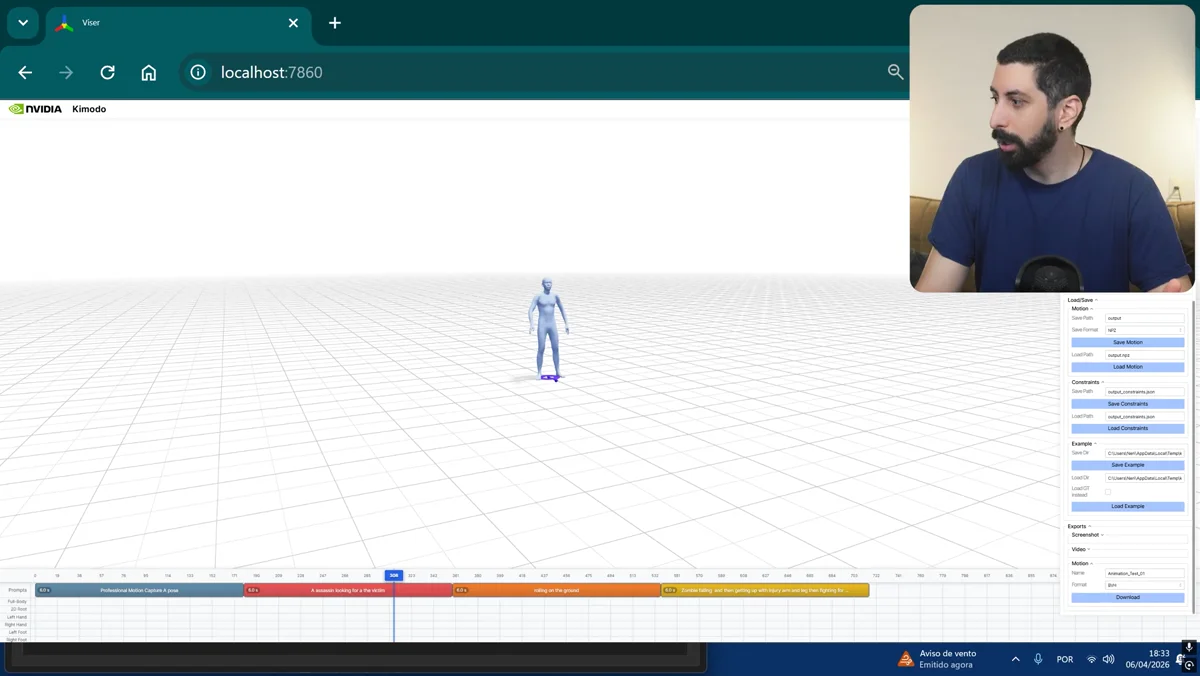

O que a IA já consegue entregar em movimentos complexos

Nos testes, a IA responde bem quando o prompt organiza a ação em partes. Um exemplo útil é começar com uma pose inicial (como em sessões de motion capture) para facilitar alinhamento e transição, e então descrever as ações em sequência.

Chamam atenção ações encadeadas e um tipo de blend contextual: o modelo tende a considerar o estado do corpo antes de “pular” para o próximo movimento, criando transições que fazem sentido em vez de cortes secos. Até prompts longos e “bagunçados” podem render resultados interessantes, com variações como rolamento, preparo de postura e movimentos de personagem ferido.

Por que isso tende a ficar muito mais fácil em breve

Ferramentas assim podem parecer confusas no primeiro contato, mas a história da tecnologia é previsível: o que hoje exige tentativa e erro costuma virar recurso integrado e acessível depois. O mais provável é que surjam camadas de automação, presets e integrações profundas com engines e plataformas.

Também é difícil ignorar o rumo: uma integração direta com pipelines de tempo real — especialmente na órbita de Unreal + Nvidia — parece questão de tempo. Quando esse encaixe ficar simples, criar animação deixa de ser um bloqueio tão grande para projetos independentes.

O que muda para quem cria jogos e experiências em 3D

O impacto maior não é “substituir animação”, mas reduzir o custo de explorar ideias. Geração por texto pode acelerar protótipos, testes de cena e variações de atuação corporal, liberando tempo para direção, ajustes finos e consistência.

3D ainda exige fundamentos: rig, retargeting, limpeza de curvas, timing e leitura. A diferença é que a IA começa a preencher o trecho mais pesado do processo, deixando o trabalho mais próximo de direção e refinamento do que de produção do zero.

O salto real aparece ao comparar o “antes e depois” do pipeline: de captura com sensores e trajes para a geração de movimento por prompt, exportável e reaproveitável.

Fonte: Neriverso