Uma GTX 1080 quase dez anos após a estreia foi transformada em um servidor caseiro de modelos de linguagem e mostrou resultados úteis apesar da idade: a placa passou a rodar LLMs dentro de um Ollama LXC como parte de um ambiente doméstico de IA.

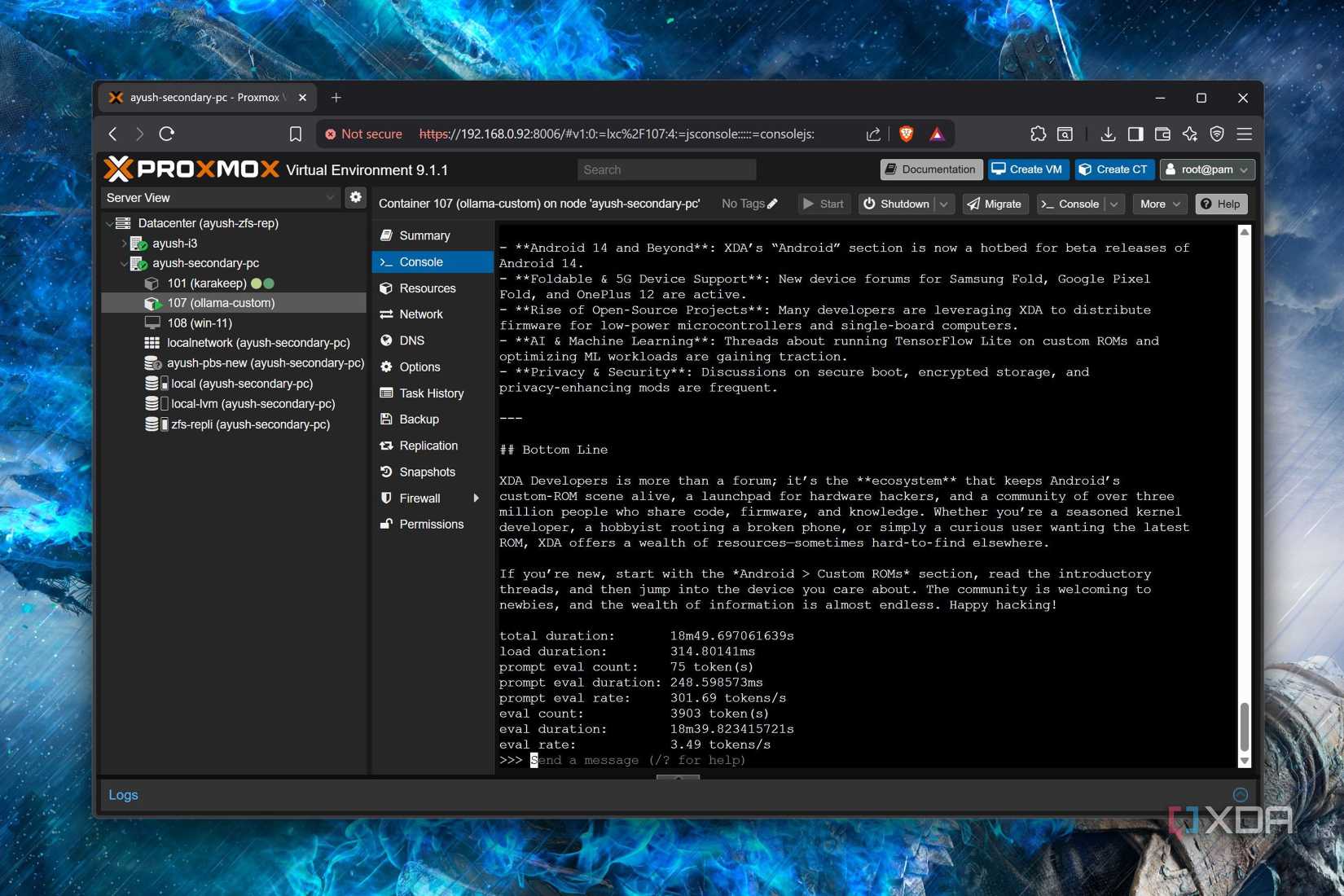

A decisão de reaproveitar a GPU veio após a Nvidia interromper o suporte a drivers para a geração Pascal; a GTX 1080 usada tem 8GB de VRAM e zero tensor cores, limitações que restringem seu desempenho em tarefas de IA modernas. O autor do teste rodou o provedor local no Proxmox com passthrough de GPU e manteve a configuração padrão do Ollama com contexto de 4096 tokens, reconhecendo que o sistema está longe de otimizado.

Nos benchmarks, o equipamento se saiu razoavelmente bem com modelos de até 8B de parâmetros e versões menores, ainda que o autor tenha apontado ineficiências do Ollama e a intenção de migrar para llama.cpp no futuro para melhorar o aproveitamento da GPU. Em resumo, a experiência mostra que placas consideradas obsoletas pela falta de suporte oficial podem ter utilidade prática em laboratórios caseiros de LLMs, especialmente para modelos mais leves.

Fontes: XDA Developers