A Nvidia lançou o Kimono, uma tecnologia de IA capaz de gerar animações 3D a partir de comandos em texto. Na prática, basta descrever uma ação e o sistema retorna um movimento coerente, com potencial para acelerar prototipagem, pré-visualização e produção de conteúdo em jogos, experiências 3D e simulações.

O ponto mais relevante é a acessibilidade: o módulo está disponível para download e execução local. Isso abre espaço para pipelines mais independentes, reduzindo a dependência de sessões completas de captura de movimento para ações genéricas de personagem, como caminhar, correr, pegar objetos, virar rápido e interagir com o ambiente.

Do prompt ao movimento: o que o Kimono entrega

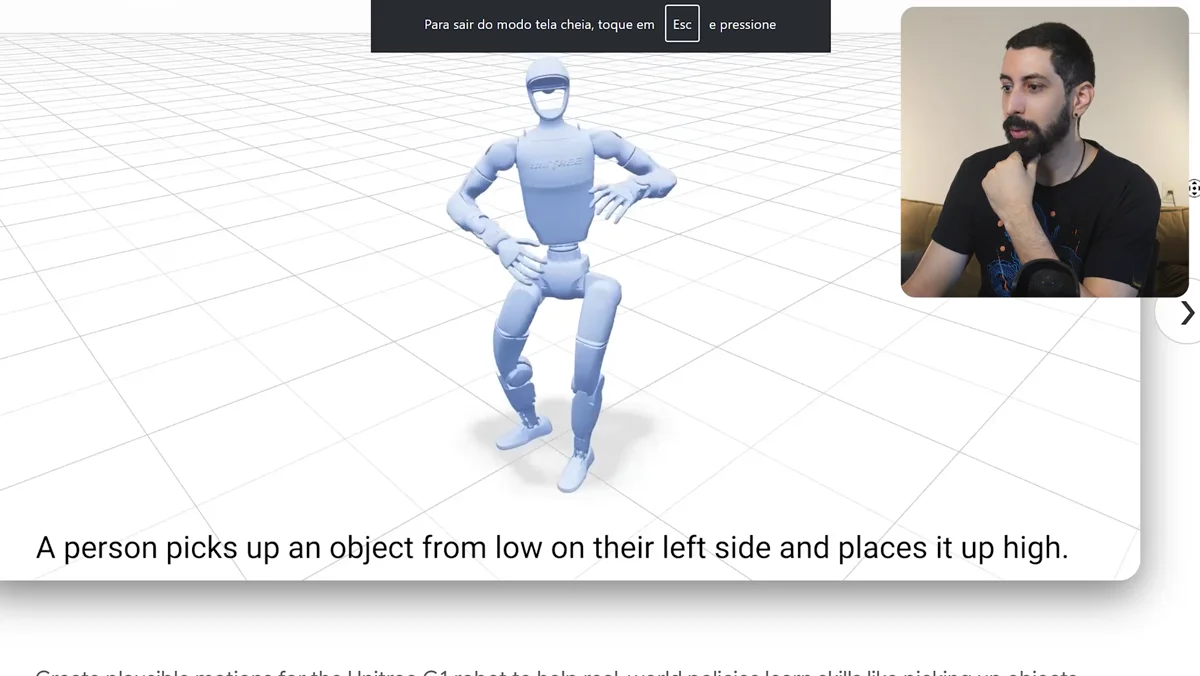

O Kimono foi treinado com uma grande base de dados de motion capture. O objetivo é simples: converter descrições textuais em uma animação que já nasce com leitura clara de intenção e timing, permitindo gerar sequências úteis para locomotion e ações utilitárias típicas de gameplay.

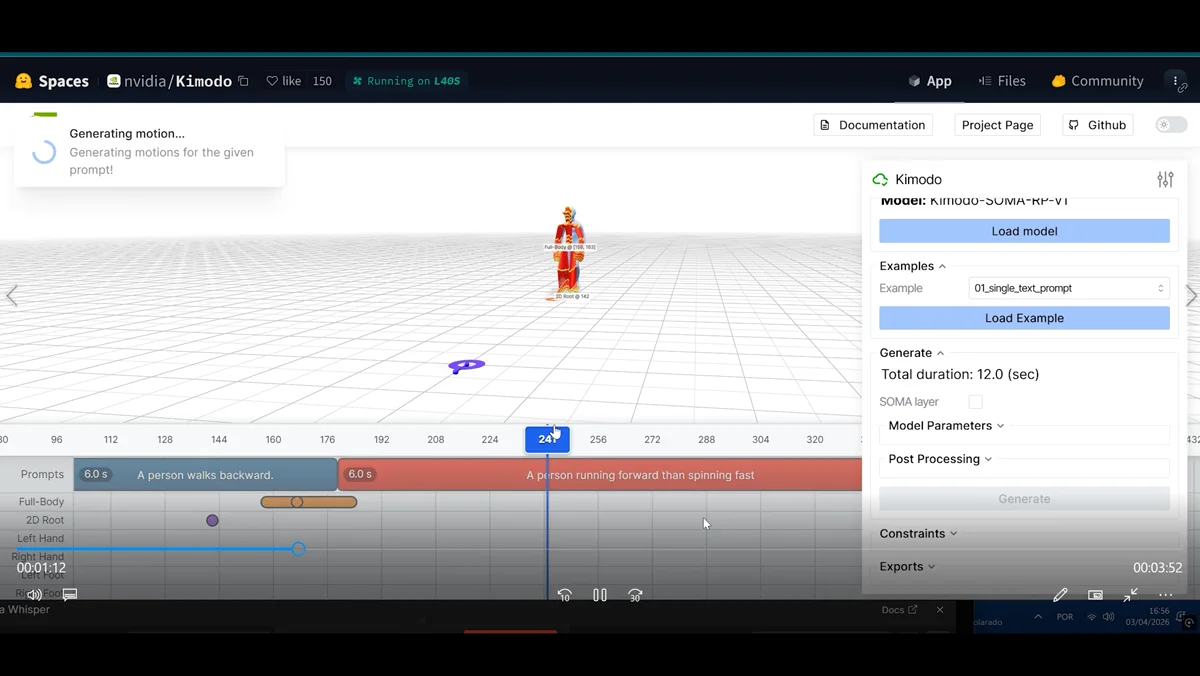

Prompts curtos tendem a produzir resultados mais genéricos, o que pode ser vantajoso para montar uma biblioteca inicial de movimentos. Comandos um pouco mais específicos permitem explorar variações, como corrida com mudança brusca de direção, caminhar para trás enquanto aponta, ou quedas e recuperação.

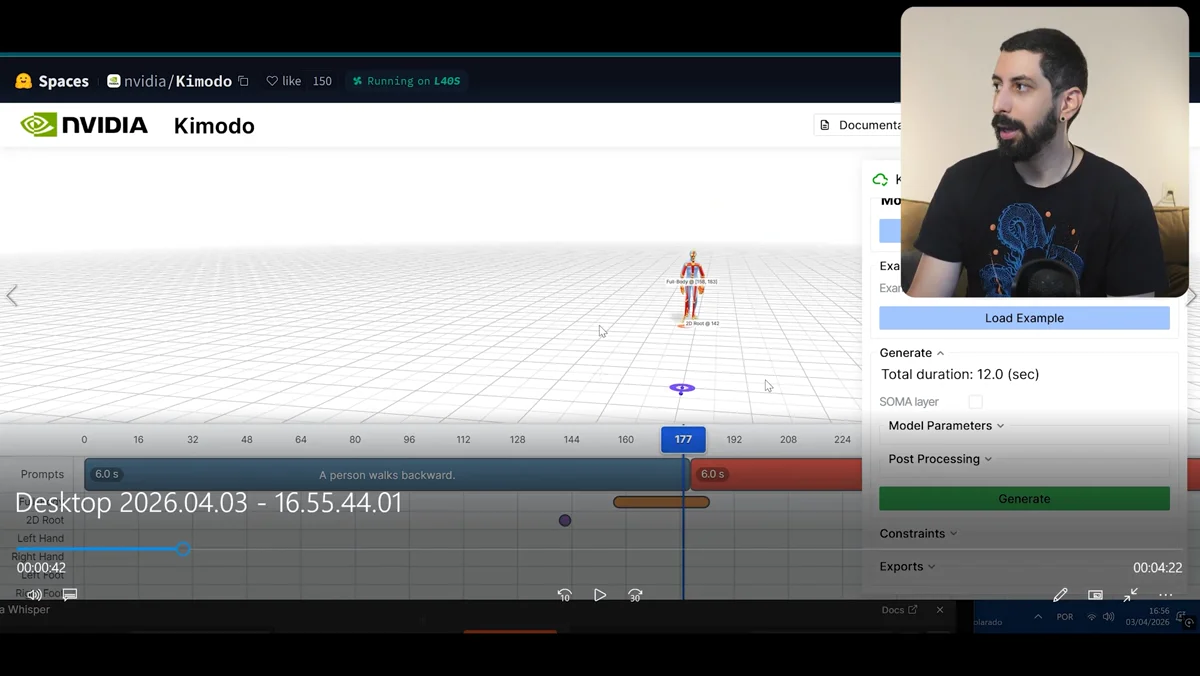

Teste rápido via demo e exportação do arquivo

Além do uso local, existe uma demo com viewport 3D e um fluxo de teste focado em velocidade: um campo de prompt e execução rápida do processamento. Em poucos minutos, dá para gerar várias ações e avaliar a qualidade do resultado diretamente na visualização.

A exportação não é feita em FBX nessa etapa, mas há suporte a BVH, um formato bastante comum em captura de movimento e compatível com ferramentas de retarget e limpeza. Isso facilita levar o material para um pipeline de animação e, depois, integrar em engines como Unreal Engine, Unity e Godot.

IA não finaliza o jogo: ainda existe trabalho técnico

Apesar do salto de produtividade, a animação gerada ainda precisa passar por um processo de integração. Em jogos, frequentemente será necessário ajustar root motion, orientação, direção correta de deslocamento, retarget do esqueleto, transições e adequação ao capsule/character controller para a locomoção acompanhar o personagem de forma limpa.

Isso reforça um ponto importante: IA tende a amplificar quem já domina o pipeline. A tecnologia encurta etapas caras e demoradas, mas não substitui as decisões de design, a montagem do cenário, a narrativa, o controle de qualidade e os ajustes finos que tornam a animação “jogável”.

Impacto para indies, prototipagem e até robótica

A democratização é o efeito mais evidente. Animações que antes exigiam estúdio, ator, roupa de captura, calibração, espaço e pós-processamento passam a ficar mais próximas de equipes pequenas e fluxos solo, principalmente para ações genéricas e iterações rápidas.

Também existe interesse além de games: a mesma lógica de gerar movimento pode ser aplicada em simulação, inclusive com a ideia de transferir o resultado para robôs e ambientes físicos, ampliando o uso do modelo para pesquisa e automação.

O que tende a continuar se destacando é a qualidade: a IA acelera a produção, mas o resultado final ainda depende de conhecimento e refinamento técnico.

Fonte: Neriverso