Uma única configuração do LM Studio permite transformar um modelo de IA executado localmente em um servidor que pode ser acessado por outros dispositivos conectados à mesma rede.

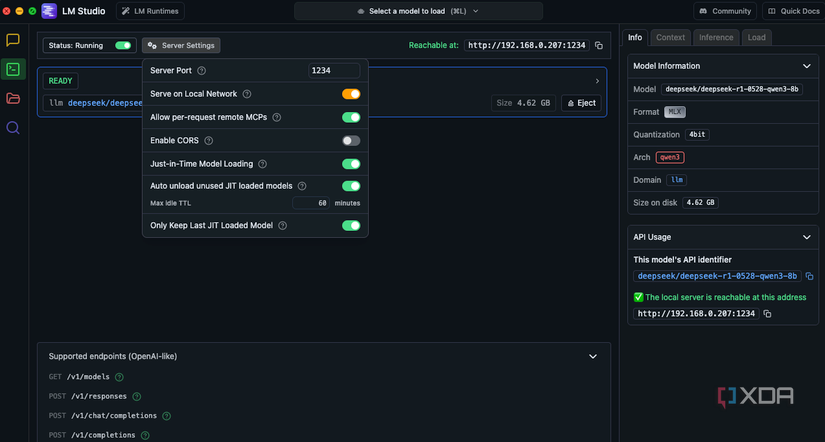

O aplicativo inclui um modo de servidor que expõe o modelo por meio de um endpoint de API. Por padrão o serviço fica ligado apenas à máquina onde o programa roda, porque o endpoint está vinculado ao localhost, mas basta ativar a opção que permite que o servidor escute na rede local para que outros dispositivos consigam enviar requisições.

Na prática, a mudança transforma ferramentas de IA locais que antes só funcionavam em um único computador em um servidor local acessível de laptops, tablets e outros aparelhos da casa, sem a necessidade de serviços externos.

Fontes: XDA Developers