A Epic Games adquiriu a startup alemã de IA Meshik e levou a equipe para o seu grupo de pesquisa em inteligência artificial — um movimento que pode destravar o maior gargalo do MetaHuman: a animação realista de corpo (e até expressões faciais) a partir de vídeo comum, com promessa de integração oficial ao Unreal Engine.

Para quem já trabalha com humanos digitais no UE5, a dor é conhecida: criar um MetaHuman é a parte “fácil”. O trabalho pesado vem depois, na cadeia de animação — captura de movimento (mocap), retargeting (transferir a animação para outro rig), limpeza de dados e ajustes para o corpo “parecer vivo”. É exatamente nessa etapa que a aquisição mira.

O que a Meshik traz para o Unreal Engine

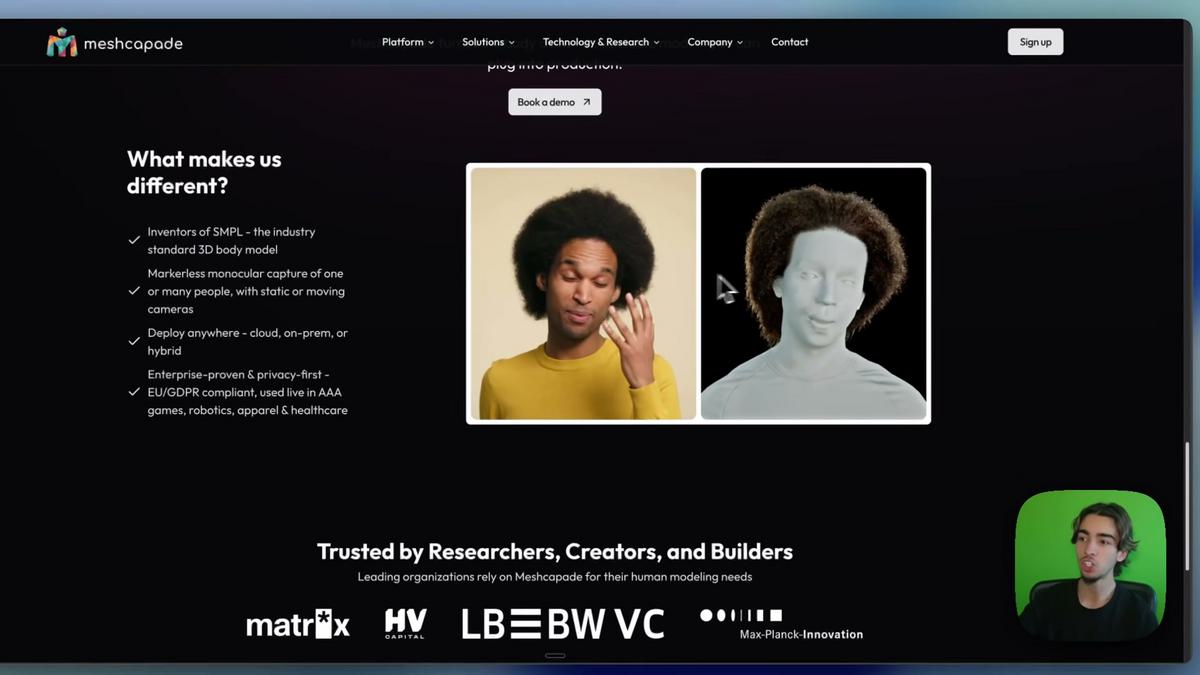

Segundo o vídeo, a tecnologia da Meshik converte movimentos humanos capturados em vídeos padrão em animação 3D pronta para uso. Em termos práticos: filmar uma pessoa (até com celular) e gerar movimento de corpo para personagens no Unreal, reduzindo a dependência de setups caros e pipelines cheios de ferramentas intermediárias.

A leitura é clara: ao incorporar a equipe ao núcleo de IA da Epic, a empresa sinaliza que a solução não deve ficar como “plugin isolado”, e sim ganhar conexão direta com o ecossistema do Unreal Engine e do MetaHuman — o que muda o jogo para jogos, cinema e virtual production.

Por que isso mexe com MetaHuman “para sempre”

O ponto central não é só criar mais rostos realistas. O salto está em tornar a animação de humanos digitais mais acessível e expressiva: movimento crível, tempo de iteração menor e possibilidade de produzir cenas com múltiplos personagens a partir de gravações comuns, sem a mesma carga de keyframes e retrabalho.

O vídeo também destaca que a Meshik é associada ao desenvolvimento de modelos corporais 3D usados como base na indústria e em pesquisa — e que os demos indicam captura não só do corpo, mas também de expressões faciais. Em linguagem simples: não é apenas “mover um boneco”; é aproximar a performance do ator (corpo e atuação) do personagem digital com menos fricção.

O que muda para devs, estúdios e criadores

Para game devs menores, isso pode significar cinematics e NPCs mais naturais sem um time dedicado de animação. Para estúdios e virtual production, abre caminho para previs, protótipos e cenas finalizadas com menos dependência de estúdio de mocap — acelerando testes, bloqueios de cena e até conteúdo para avatares e criadores.

Quer ver os exemplos e o argumento completo em ação? Assista ao vídeo original, onde a tecnologia e os casos de uso são apresentados na prática.

Fonte: Gorka Games